微软与openai建立合作关系 微软整合openai的ai技术

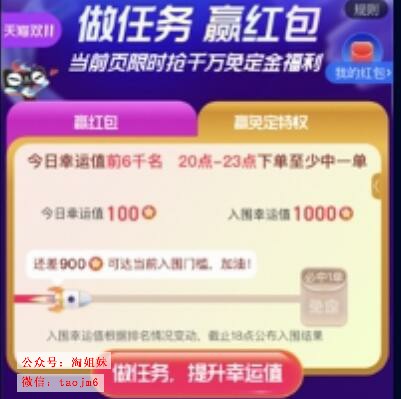

淘宝搜:【天降红包222】领超级红包,京东搜:【天降红包222】

淘宝互助,淘宝双11微信互助群关注公众号 【淘姐妹】

一家不以盈利为目的的公司,该如何长久地运转下去?4 年前,伊隆・马斯克(Elon Musk)等诸多硅谷大亨在成立非营利性组织 OpenAI 时,显然都低估它所需要的人力和资金。

微软今天宣布,将向 OpenAI 投资 10 亿美元,以协助其开发 AGI(通用人工智能)平台,解决更多科学难题,共同实现人工智能技术的民主化。

这并非是微软与 OpenAI 团队的第一次接触。早在 2016 年,微软旗下的 Azure 云服务就曾为 OpenAI 提供深度学习和神经网络渲染等大规模实验所需要的算力条件,当时微软还获得了 OpenAI 的人工智能技术与专家支持。

▲ 左边是 OpenAI 的 CEO Sam Altman,右边是微软 CEO 纳德拉

不同的是,在这笔投资后,未来微软就会成为 OpenAI 的独家云供应商,同时 OpenAI 也会和微软合作开发 Azure AI 超级计算技术,并授权微软使用其部分技术进行商业化。

然而,不少业内人士都对本次合作抱以质疑态度。它们担心 OpenAI 会受到微软的影响,屈服于财政压力和利他因素,无法再像以前一样保持开放、平等传播的姿态。

但事实上,OpenAI 已经于今年 3 月进行了一轮重组,成立了名为「OpenAI LP」的子公司,目的就是为了更好地筹集资金,吸引人才,继续与 Google、亚马逊等这些大公司在 AI 领域进行竞争。

也因这次转型,现在的 OpenAI 已不再是纯粹的非营利性组织,而是一个混合了营利与非营利性质的混合企业。

对此,OpenAI 的创始人 Greg Brockman 接受 Vox 采访时则表示,人工智能研发不仅需要的巨大算力,也需要庞大的资金。一个非营利组织在筹款上是有极限的,而弥补成本最有效的方式,就是改变现有架构。

另外,OpenAI 也在一份分析报告中指出,从 2012 年至 2018 年,最大规模的 AI 训练所需要的算力已经增长了 30 万倍,等于说是每 3.5 个月便翻一番,远超摩尔定律的速度。

对算力的渴求,也可以视为是本次 OpenAI 和微软合作的契机之一。

▲ OpenAI 的机械手系统 Dactyl

目前 OpenAI 的重点,仍然是构建一个「能够做所有事的 AI」――也就是开头提到的「AGI(通用人工智能平台)」。

如字面意思,它不再是那种只是为解决一个特定问题而生的人工智能系统,而将「集大家之所长」,拥有更接近人类的思考方式,帮助解决人类现存的气候、医疗等科学难题,堪称是真正意义上的「人工智能」。

但实现 AGI 并不容易,多数专家认为,目前绝大多数的机器学习仍依赖于数据堆砌,缺乏根本性的技术突破,存在一定的发展瓶颈。

Google 工程总监 Ray Kurzweil 曾在一次非正式采访中表示,直到 2029 年,人类才有超过 50% 的概率打造出 AGI 系统;而家用机器人公司 iRobot 的联合创始人 Rodney Brooks 则更悲观些,他预估的时间点为 2200 年,还有一些专家认为是 2099 年左右。

长远来看,微软的投资更像是在为未来买单;当然它也可以借助 OpenAI 已有的强化学习平台和神经网络项目,改进自家 Azure 平台和云计算领域,更好地展开商业化。

目前,OpenAI 最被大众消费者所熟知的成就,是在电竞领域击败了《Dota 2》游戏的前世界冠军。这就和 Google 旗下的 DeepMind 一样,后者同样在《星际争霸 2》中战胜了不少职业玩家,并强调 AI 所具备的复杂运算和决策思维。

今年 2 月,OpenAI 还展示了一个自然语言处理模型 GPT-2,你只要为它提供一小段文字,它就能根据自己的理解来编写余下的内容,小说、新闻都不在话下。

但这些项目仍然与理想中的 AGI 有很大距离,OpenAI 要达成的这个目标,大概也不是微软这 10 亿美元就能解决的。

题图来源:OpenAI

ai普通人的机会在哪里 ai智能推荐入口

爱普通人的英文,ai与人类,ai和人的区别,做个ai吗2021年11月,智源社区举办AI大调查,面向社区成员及广大AI领域的研究者和从业者,收集反馈意见和建议。目前已收到回复9000多份,根据智源社区2021AI大调查票选结果,我们选出了2021年人工智能领域十大技术进展事件,如下:

1.David Card、Joshua D.Angrist和Guido W.Imbens三人因对经济学研究的实证研究和因果推断的贡献获得诺贝尔经济学奖

挖掘因果关系是众多科学研究的目标。近年来在各个科学领域,特别是大数据和人工智能领域对因果推断研究的热情高涨,图灵奖获得者Judea Pearl 和Yoshua Bengio都认为因果推断是大数据和人工智能研究的一个突破口,人们需要一场“因果革命”来推动人工智能的发展。但因果推断也面临观察性研究、混杂因素、缺失数据带来的挑战。

2021年诺贝尔经济学奖授予加州大学伯克利分校的David Card、MIT的Joshua Angrist、斯坦福大学的Guido Imbens,以表彰他们在经济学研究的实证研究和因果推断方法方面的贡献,其科学背景是观察性数据的因果推断。

Card使用自然试验作为工具变量分析劳动经济学中一系列重要的因果问题,重塑或加深了人们对这些因果关系的认识,如发现提高最低工资并不会减少就业,推翻了人们对最低工资和就业之间关系的广泛认识。Angrist和Imbens将工具变量与潜在结果模型结合,使用潜在结果模型刻画工具变量假定和相应的统计模型,定义新的因果概念,发展新的统计推断方法―相当于重建了工具变量方法。

链接:https://hub.baai.ac.cn/view/12999

2.OpenAI发布多模态预训练模型DALL・E和CLIP

1月,OpenAI同时发布了两个大规模多模态预训练模型――DALL・E和CLIP。DALL・E可以基于短文本提示(如一句话或一段文字)生成对应的图像,CLIP则可以基于文本提示对图片进行分类。OpenAI表示,研发多模态大模型的目标是突破自然语言处理和计算机视觉的界限,实现多模态的人工智能系统。

链接:

https://hub.baai.ac.cn/view/5643

https://hub.baai.ac.cn/view/6636

3.谷歌发布1.6万亿参数模型Switch Transformer

1月,谷歌研究人员研发出新的语言模型Switch Transformer,包含1.6万亿个参数,是包含1750亿参数的GPT-3的九倍。研究者将Switch Transformer与谷歌研究的T5-Base和T5-Large模型进行了对比,结果表明,在相同的算力资源下,新模型实现了最高7倍的预训练速度提升。

链接:https://hub.baai.ac.cn/view/5807

4.智源研究院发布万亿规模超大规模智能模型悟道2.0

6月1日,智源研究院发布“悟道2.0”模型,参数规模达到1.75万亿,是GPT-3的10倍,打破由Switch Transformer预训练模型创造的1.6万亿参数记录,是中国首个万亿级模型。

链接:https://hub.baai.ac.cn/view/8375

5.AlphaFold2算法和蛋白质结构预测数据集开源

7月,DeepMind使用新开发的AlphaFold2算法预测出了35万种蛋白质的结构,其中包括人类基因组表达的约2万种蛋白质,以及其他20种生物学研究中的常用模式生物(如大肠杆菌、酵母和果蝇)表达的蛋白质,是过去用实验方法解决的蛋白质数量的两倍多。

研究发现,AlphaFold2能对人类蛋白质组中58%的氨基酸结构位置给出可信预测。35.7%的结构位置的预测达到了高置信度,是实验方法覆盖结构数量的两倍。在蛋白层面,AlphaFold2对43.8%的蛋白中至少四分之三的氨基酸序列都给出了可信预测,该研究于7月22日登上《自然》杂志。

DeepMind宣布,已与欧洲生物信息研究所(EMBL-EBI)合作建立AlphaFold DB蛋白质结构数据库,将覆盖98.5%的人类蛋白质信息,预测结果免费开放。12月,这项研究被《自然》杂志评为2021年度技术突破。

7月,华盛顿大学、哈佛大学等的研究者提出蛋白质结构预测算法RoseTTAFold,该方法基于深度学习,通过在蛋白质序列信息的学习,能够快速生成蛋白质的精确结构,减少传统方法在实验测定等方面投入的时间和精力。目前该算法已开源。

链接:https://hub.baai.ac.cn/view/13099;

https://hub.baai.ac.cn/view/8901

6.微软亚洲研究院提出Swin Transformer视觉预训练模型

8月,微软亚洲研究院研究者提出了Swin Transformer的视觉架构,一是采用CNN中常用的层次化构建方式,构建层次化Transformer;二是引入局部性(Locality)的思想,采用多种尺度的窗口,对无重合的窗口区域内进行Self-Attention计算。

实验结果表明,Swin Transformer在COCO的分割和检测任务以及ADE20K的语义分割任务上都超越了CNN,达到了最佳性能。Swin Transformer因其在计算机视觉领域的贡献获得ICCV2021最佳论文奖(马尔奖)。11月,Swin Transformer升级,可以训练分辨率达1536x1536的图像,在4个视觉基准上刷新纪录。

链接:https://hub.baai.ac.cn/view/12251

7.何恺明团队提出Masked Autoencoders视觉预训练方法

11月,Facebook何恺明团队提出了一种名为掩码自动编码器(Masked Autoencoder,MAE)的视觉训练方法。该方法在对于输入图像的局部进行了遮盖,并通过不对称的编码器-解码器结构对缺失像素进行重建。预训练后,撤除解码器,可将完整的图片输入编码器,使其完成视觉任务。实验结果显示,该方法在多种任务上都可以用更少的数据实现较高性能。

链接:https://hub.baai.ac.cn/view/11710

8.智源、清华等提出Pre-Train Prompt Tuning(PPT)框架

9月,清华大学黄民烈、刘知远等研究者提出了名为Pre-trained Prompt Tuning(PPT)的方法,目的是为了改进Prompt Tuning在小样本任务上的性能弱于Fine-tune方法的问题。研究者将分类任务(sentence-pair、multiple-choice、single-text)都统一到一种任务中,并预训练Soft Prompt。测试中,研究者采用了T5、mT5和CPM-2三种模型,对比了微调和多种Prompt Tuning训练策略的结构。实验表明,PPT在大多数任务上具有明显的性能优势。

链接:https://hub.baai.ac.cn/view/9890

9.斯坦福大学研究者利用AI和脑机接口实现“意念写字”

当前,脑机接口已经可以实现一定程度的大脑和计算机之间的沟通,如让瘫痪患者能够操控光标打字等,但是对于一系列高度灵巧的行为来说,解码这些行为背后的脑电信号需要更高精度的脑电解码方法。

5月,斯坦福大学的研究者提出了一种新型的脑机接口系统,采用循环神经网络,能够将来自运动皮层的手写字脑电信号解析为文本。在线情况下,该脑机接口实现了90字/分钟的速度,准确率为94.1%,在有自动纠错软件的支持下,离线的准确率高达99%。

链接:https://arstechnica.com/science/2021/05/neural-implant-lets-paralyzed-person-type-by-imagining-writing/

10.谷歌发布改进版视觉预训练模型ViT

2020年10月,谷歌大脑团队首次尝试将标准Transformer应用于图像,提出了视觉Transformer(ViT)模型,并在多个图像基准上接近甚至优于最佳性能。6月,ViT团队尝试将ViT模型进行扩展,训练出具有20亿参数的变体模型ViT G/14,在ImageNet数据集上达到了新的最佳性能。

链接:https://hub.baai.ac.cn/view/4653

马斯克谈ai超越人类 马斯克谈ai威胁论

马斯克谈降价,马斯克谈氢燃料汽车,马斯克谈微信,马斯克谈特斯拉降价钛度要点 曾公开表示AI是“堪比核武器的存在”的马斯克却启动了一项人工智能项目“OpenAI”。虽然成立OpenAI的风险是未知的,但他们有一个崇高的目标:相信人工智能可以安全地推动人类个体意志、自由精神的发展。

15年12月12日,特斯拉CEO Elon Musk在Twitter上宣布正式启动非盈利人工智能项目OpenAI。

OpenAI是一个非营利性的人工智能研究公司,目标是 “推动数字智能的发展,同时不被财务回报所限制,从而造福整个人类”。

消息一经公布,立即成为业界关注。很多人认为,OpenAI令他们兴奋又期待,他们等不及想要看到OpenAI给人类世界带来的改变。但也存在一些质疑的声音,一个融资10亿美元的非盈利组织和一群谷歌科技大牛可以防止人工智能颠覆人类吗?OpenAI究竟是个什么?

人工智能一直是一个热议不断的领域。

当前,人们担心人工智能的发展会让自动化的机器完全取代人类的工作,就连Elon Musk也直言不讳地提出过这样的担忧。

早期,人们认为解决某些任务(比如国际象棋)会引导我们去研发人类水平的智能算法。然而,成果却不尽人意。

但在过去几年内,却出现了一些转机。在深度学习中,你并不需要手工编程每个新算法,只需要在容纳海量数据的算法中输入数据就可以自行生成新算法架构。

这种技术在模式识别领域取得了喜人的业绩,包括物体图像识别、机器翻译和语音识别等。人们开始看到了计算机对于世界的创造力。

当今的人工智能令人印象深刻,但其功能十分局限。研究人员在不断突破约束,在未来的某一天,机器可以达到像人类一样的知识智能,几乎可以完成人类社会所有的任务。很难想象人类水平的人工智能可以给社会带来多少福利,也很难想象如果使用不当,人工智能会给社会带来怎样的破坏。

虽然成立OpenAI的风险是未知的,但他们有一个崇高的目标:相信人工智能可以安全地推动人类个体意志、自由精神的发展。

但同时他们也提出警告:这个项目的投资风险尚难决断,但他们会保持初心。

基于人工智能的发展历史,我们很难预测人类水平的人工智能会在何时出现。当它真正出现时,必须有一个机构来领导其向正确的方向发展。

OpenAI被期待发展成这样的一个机构。

作为一个非盈利组织,OpenAI的目标是为每个人创造价值。他们强烈建议研究人员公开他们的研究成果,包括论文、博文、代码和专利,与世界共享。OpenAI将通过和科研人员和企业的合作,不断研发新技术。

OpenAI的研究总监是来自谷歌的世界著名机器学习专家Ilya Sutskever,首席技术官是支付公司 Stripe前首席技术官 Greg Brockman。

团队的其他成员都是世界级的工程师和科学家,包括:著名创业孵化器YCombinator的联合创始人Trevor Blackwell,曾就职于TrueVault的Vicki Cheung,斯坦福大学研究生Andrej Karpathy,谷歌机器学习研究员Durk Kingma、加州大学伯克利分校计算机科学博士John Schulman,Facebook人工智能研究员Pamela Vagata,纽约大学深度学习博士生Wojciech Zaremba。

OpenAI的顾问团队包括:美国加州大学伯克利分校计算机系Pieter Abbeel教授,加拿大蒙特利尔大学机器学习Yoshua Bengio教授、天才计算机大师Alan Kay、谷歌科学家Sergey Levine和SAP全球首席技术官Vishal Sikka。

Sam Altman和Elon Musk共同担任OpenAI的联合主席,Sam Altman是著名创业孵化器YCombinator的CEO,Airbnb就是从YC走出来的企业。

OpenAI获得来自特斯拉CEO Elon Musk、LinkedIn联合创始人雷德61霍夫曼、YCombinator联合创始人杰西卡61利文斯顿、PayPal 联合创始人彼得61泰尔、亚马逊AWS、印度Infosys公司和YC研究院的资金支持。

这个组织并不以盈利为目的,因此可以专注于人工智能的积极方面。在最初的几年,10亿美元资助大概只会花费一小部分。

Navia Systems的创始人Beau Cronin一直关注着人工智能领域,他最近在接受媒体采访中表示,在OpenAI建立初期,它并不能立即见效地解决一些不可避免的问题。

还有些人认为,试图限制人工智能的发展,强迫其往人类友好的方面去发展是不现实的,迟早会有人会因为某些原因打破这个约束的。OpenAI会加速我们进入后人类时代。

David J Klein是一名人工智能的研究者和实践者,他更关心的是这个组织是否能带来相应的成果,并且谁能从中受益。

Klein表示,前微软创始人Paul Allen曾在90年代投资1亿美元到先进技术智囊团中,后来该项目却无疾而终,Paul表示该项目是“研究过多但力度不够”。

OpenAI非盈利组织的身份并没有太多意味。他们已经有了10亿美元的投资,近几年并不需要更多的筹款。非盈利组织也可以给他们的成果申请专利,然后决定这些成果的使用者和使用成本。

另一方面,Klein认为,人工智能智囊机构独立于谷歌和Facebook这样的公司而存在是值得称赞的。这样的机构类似于Allen人工智能研究所,但更纯粹专注于机器学习,特别是深度学习方面。团队的成员组成非常坚实。这样一个机构致力于为人工智能做增量研究,完全可以收获许多成果。

目前OpenAI已经公开招聘工程师和研究人员。在Klein眼里,OpenAI这样公开和谷歌、Facebook等科技巨头争夺人才十分有趣。OpenAI可能会因为他们的开放性和非赢利性而取胜。科技巨头们之间可能又会陷入一场人才战争中,比比谁的人才更高质量,谁的机构更加开放。

就这样,OpenAI成立起来了,它试图建立平衡人工智能发展的天网,防止人工智能意外发生。OpenAI当下的任务还比较模糊。

他们将会注重于怎样的“利益”?他们会怎样定义和衡量“利益”?他们只是致力于研发“仁慈的人工智能”,还是试图解决当前人类面临的最主要问题?

如果能最终消除人工智能对人类的威胁,那就最好了,这是人类真正需要的东西。毕竟,没有人想看到《终结者》的故事在现实中上演:

人类研制的全球高级计算机控制系统“天网”全面失控,机器人有了自己的意志,将人类视为假想敌人,并发射核弹到地球的各个角落,杀死了几十亿人。余下来的人类在约翰61康纳的领导下,用有限的资源和武器与强大精良的机器人周旋作战……